Pouvez-vous me traduire cette phrase dans 150 langues différentes ? Gérer en temps réel plusieurs voitures en évitant qu’elles se cognent ? Classer en quelques secondes des milliers de photos ? Non ? Dans ce cas-là, pouvez-vous simplement répondre à cette énigme : Un homme entre dans un restaurant. Il commande un steak. Il laisse un gros pourboire.

Qu’a mangé l’homme ?

La réponse vous semble évidente ? Pourtant elle ne l’est pas pour une intelligence artificielle (IA) puisque à aucun moment il n’est précisé que l’homme a mangé le steak. Tandis qu’avec suffisamment d’entraînement, une IA pourra répondre aux premières questions sans sourciller. Pour comprendre comment un système aussi avancé peut mal répondre à cette simple énigme il faut comprendre comment elle répond juste aux questions complexes.

L’intelligence artificielle actuelle utilisant des réseaux neuronaux est dite connexionniste. Elle reproduit en partie le fonctionnement des réseaux neuronaux biologiques qui prennent des informations dans des neurones en entrée, passent ensuite les informations à travers des couches de neurones qui font chacun des micro-calculs et produisent une information en sortie. Chaque neurone est arrangé d’une façon précise et pour obtenir cet ensemble et il faut faire de nombreux essais avec de nombreuses informations différentes jusqu’à que ce soit arrangé « correctement » et produise l’information qu’on souhaite. Cette technique dite de « deep learning » est la plus avancée pour développer des modèles d’intelligences artificielles performants mais possède deux défauts majeurs.

En premier lieu, le « cheminement de pensé » permettant d’avoir un résultat est opaque et seulement compréhensible par l’intelligence artificielle même. De plus, il est obtenu pour certaines actions précises, l’IA n’acquiert pas pour autant une conscience du monde dans lequel elle est. Pour reprendre l’énigme du début, si elle répond correctement, on ne pourra expliquer comment elle est arrivée au bon résultat ni réellement comprendre ce que signifie manger.

En second lieu, il faut une quantité gigantesque de données pour affiner le raisonnement et trouver le bon « arrangement » des réseaux de neurones et une partie ou l’entièreté de ces données peuvent être biaisées. C’est comme cela que l’on obtient une intelligence artificielle qui classe les photos de personnes noires dans la catégorie « Gorille » ou qui déclame des propos nazis sur Twitter. Si le deuxième défaut apporte plutôt des problèmes éthiques et sociétaux, le premier apporte un véritable blocage intrinsèque empêchant l’intelligence artificielle d’avoir du bon sens. Selon Yejin Choi, chercheuse et professeur à l’institut Allen en intelligence artificielle, « Cette absence est peut-être l'obstacle le plus important entre les applications d'IA étroitement ciblées que nous avons aujourd'hui et les applications d'IA plus générales que nous aimerions créer à l'avenir ». C’est un sujet si important que la DARPA, la branche de recherche de l’armée américaine a lancé une compétition menée par la MSC (Machine Common Sense) pour le développement d’intelligence artificielles avec du sens commun en leur demandant de donner du sens à des questions simples.

Ce questionnement du bon sens n’est en fait pas nouveau puisqu’en 1958, aux balbutiements de l’intelligence artificielle, la question était déjà posée dans un papier intitulé « Programs with Common Sense ». Cette recherche du sens commun est appelé « matière noire de l’IA » en référence aux propose d’Oren Etzioni, directeur de l’institut Allen en 2018 et a fait naître nombre de tentative pour la résoudre.

La première de ces tentatives est également liée aux premiers développements de l’intelligence artificielle. Dans les années 60, l’IA n’était pas connexionniste mais symboliste, plus proche de la logique verbale humaine. L’objectif est de relier tous les signifiants du monde à tous leurs signifiés. Si tout le sens commun pouvait être écrit, une ordinateur pourrait les utiliser pour raisonner de la même manière qu’en algorithmie. En 1984, le projet Cyc fut lancé avec l’objectif d’encoder toutes les connaissances implicites de bon sens nécessaires pour représenter 400 articles d’encyclopédies. Plus de 30 ans après, Cyc contient des millions de collections et de concepts et plus de 25 millions d’affirmations. Michael Witbrock qui a initialement participé au projet affirme qu’ils pensaient que la quantité de connaissances liées à notre logique semblaient en théorie limitées mais qu’« il s’est avéré que la tâche était vraiment écrasante »

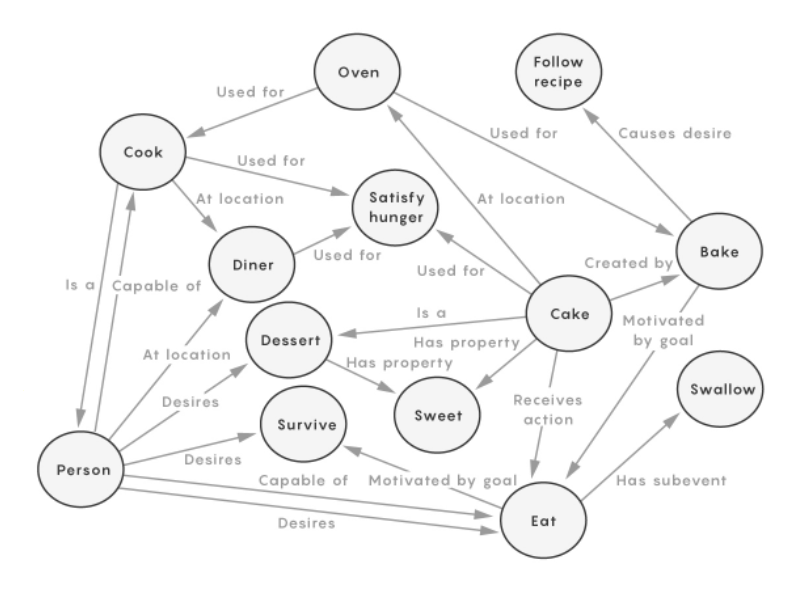

Carte de relation de seulement quelques termes. Le nombre d’interconnections montre la complexité d’une telle idée. Schéma : Quanta magazine

Selon Ellie Pavlick, chercheuse à la Brown University et à Google AI, ce projet n’aurait jamais pu fonctionner car il y a toujours une exception à chaque cas. Dans l’exemple du steak, on pourrait renseigner dans la base de connaissances de l’intelligence artificielle le cas où la personne mange le steak mais une quasi-infinité d’autres cas sont possibles: la personne pourrait partir sans payer, sans manger ou en démarrant une bataille de nourriture. Ainsi les approches symbolistes comme les approches connexionnistes sont impossibles pour enseigner le bon sens à l’intelligence artificielle.

Ce questionnement du bon sens n’est en fait pas nouveau puisqu’en 1958, aux balbutiements de l’intelligence artificielle, la question était déjà posée dans un papier intitulé « Programs with Common Sense ». Cette recherche du sens commun est appelé « matière noire de l’IA » en référence aux propose d’Oren Etzioni, directeur de l’institut Allen en 2018 et a fait naître nombre de tentative pour la résoudre.

La première de ces tentatives est également liée aux premiers développements de l’intelligence artificielle. Dans les années 60, l’IA n’était pas connexionniste mais symboliste, plus proche de la logique verbale humaine. L’objectif est de relier tous les signifiants du monde à tous leurs signifiés. Si tout le sens commun pouvait être écrit, une ordinateur pourrait les utiliser pour raisonner de la même manière qu’en algorithmie. En 1984, le projet Cyc fut lancé avec l’objectif d’encoder toutes les connaissances implicites de bon sens nécessaires pour représenter 400 articles d’encyclopédies. Plus de 30 ans après, Cyc contient des millions de collections et de concepts et plus de 25 millions d’affirmations. Michael Witbrock qui a initialement participé au projet affirme qu’ils pensaient que la quantité de connaissances liées à notre logique semblaient en théorie limitées mais qu’« il s’est avéré que la tâche était vraiment écrasante »

« Lorsque COMET a reçu le message "Personne X donne à Personne Y des pilules", il a deviné que Personne X voulait aider ; lorsqu'on lui a dit que "Personne X assassine la femme de Personne Y", COMET a suggéré que Personne X voulait cacher le corps ».

Pour Gary Marcus, chercheur et fondateur de Robust.AI, COMET souffre d’une limite fondamentale du deep learning : la statistique est différente de la compréhension. Si COMET est capable de fournir des réponses cohérentes aux questions, elle ne comprend pas pour autant les réponses qu’elle donne ni les concepts qu’elle utilise. Cela apporte un flou sur la limite de ses capacités et sur son développement possible.

Pour pallier ce problème, Choi évoque la possibilité d’enrichir son intelligence artificielle avec d’autres modèles de compréhension. Lesquels seront efficaces restent encore pour l’instant un mystère.

Pour certains chercheurs comme Ellie Pavlick, ces autres modèles seraient hors du langage comme la perception visuelle ou les sensations incarnées.

« Si je vivais dans un monde avec personne d’autre, j’aurais quand même du bon sens. Je comprendrais toujours comment le monde fonctionne et aurais des attentes sur ce que je devrais voir et ne pas voir » déclare Ellie Pavlick. Il manque l’aspect de référence réel des objets. Ce sens doit exister sous une forme qui n’est pas le langage.

Yejin Choi, utilise dans ce sens des scènes visuelles labellisées tirées de films et de séries pour tenter d’augmenter COMET. Nazeneen Rajani, chercheur à Salesforce tente de leur apprendre la physique de base en partant du principe que la langage n’était « qu’un substitut a faible dimension de la façon dont le monde réel fonctionne » et qu’il faudrait leur apprendre des choses plus compliquées. Néanmoins, ces approches n’en sont qu’à leurs prémices et nous ne savons pas encore si cela sera d’une quelconque efficacité.

Une autre approche bien différente est celle du « machine behaviour ». Cette approche part du constat de Thomas Hills de la proximité entre certains comportements humains et machiniques. La structure même des intelligences artificielles pourrait leur permettre d’avoir des « maladies mentales ». Les IA « peuvent oublier les choses plus anciennes lorsqu’elles apprennent de nouvelles informations ». C’est un phénomène propre aux réseaux de neurones qui se nomme « l’oubli catastrophique ». L’algorithme n’apprend plus rien et ne se souvient de plus rien. Thomas Hills rapproche cela d’une théorie sur le vieillissement du cerveau selon laquelle son déclin serait dû à une trop grande masse de souvenirs devenues ingérables.

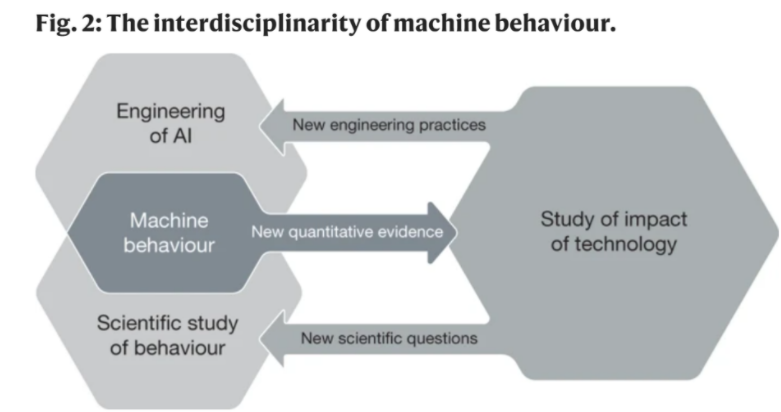

En reprenant cette idée, Iyad Rahwan et Manuel Cebrian, deux chercheurs du MediaLab du MIT ont constaté l’omniprésence des informaticiens et des roboticiens dans l’étude des IA, les mêmes personnes qui créent les intelligences artificielles et de manière plus général l’absence des autres disciplines dans l’étude du comportement des IA. Pourtant, pour étudier les comportements humains nous avons développé un florilège de disciplines pour bénéficier de perspectives complémentaires (physiologie, sociologie, neurosciences, macroéconomie, etc.) Pour contrer cela, ils appellent au développement d’une nouvelle discipline : l’étude du comportement machinique (« study of machine behaviour »). Il ne s’agit plus d’étudier le code ni de reprendre tel quel les disciplines existantes pour l’étude de l’Homme ; ils insistent sur l’écueil que peuvent être l’anthropomorphisme ou le zoomorphisme, mais de comprendre les IA comme des agents cognitifs nouveaux nommés « aliens » requérant une nouvelle méthodologie. Afin de maximiser le bénéfice potentiel des IA dans la société il faudrait étudier rapport entre les deux et les examiner dans diverses configurations. Si les auteurs mettent en garde sur la cohérence de l’utilisation d’une IA hors de sa base de données, il leur semble essentiel cet examen notamment pour une meilleure gestion de l’éthique, problème récurrent dans le domaine. I.Rahwan et M.Cebrian précisent également que le « study of machine behaviour» n’équivaut pas non plus à la reconnaissance de l’indépendance des IA ni leur responsabilité morale pour leurs actions.Yejin Choi, utilise dans ce sens des scènes visuelles labellisées tirées de films et de séries pour tenter d’augmenter COMET. Nazeneen Rajani, chercheur à Salesforce tente de leur apprendre la physique de base en partant du principe que la langage n’était « qu’un substitut a faible dimension de la façon dont le monde réel fonctionne » et qu’il faudrait leur apprendre des choses plus compliquées. Néanmoins, ces approches n’en sont qu’à leurs prémices et nous ne savons pas encore si cela sera d’une quelconque efficacité.

«Les résultats des études sur le comportement des machines fournissent des preuves quantitatives qui peuvent aider à informer les domaines qui étudient les effets potentiels de la technologie sur les systèmes sociaux et technologiques. En retour, ces domaines peuvent fournir des pratiques d'ingénierie et des questions scientifiques utiles aux domaines qui étudient le comportement des machines. Enfin, l'étude scientifique du comportement aide les chercheurs en IA à faire des déclarations plus précises sur ce que les systèmes d'IA peuvent et ne peuvent pas faire.», I.Rahwan et M.Cebrian.

Difficile d’évoquer l’étude du comportement des intelligences artificielles sans penser à la sciences fiction et récemment à la série Westworld de Jonathan Nolan et Lisa Joy. Dans la série, bien que le bon sens en lui-même ne soit pas évoqué, les «hôtes» cherchent à atteindre le centre du labyrinthe d’Arnold leur créateur : la conscience. Dans Westworld, l’accès à la conscience semble accorder aux IA une compréhension plus profonde du bon sens, d’autant plus qu’ils possèdent une interface de langage suffisamment développée pour comprendre leurs interactions verbales avec les humains. La présence des autres sens en plus d’émotions primaires pourrait-elle être lié à l’acquisition de ces autres sens? Enfin, pour le test de ces intelligences artificielles, la série part du postulat intéressant de la discussion avec eux avec en plus, la présence d’un mode particulier de méta-analyse pour accéder à la logique plus profonde des réponses qu’ils donnent. Ces discussions ressemblent fortement à une forme de psychologie, certes biaisé par l’analyse mais dont le seul moyen de compréhension des agissements de l’hôte par les humains est l’échange verbal. Finalement, la seule personne pouvant accéder et comprendre en profondeur l’intelligence artificielle n’est autre qu’elle-même.

Rédigé le 14 mai 2020

Sources :

Simonite, T. (2018) When It Comes to Gorillas, Google Photos Remains Blind, Wired. Available at: https://www.wired.com/story/when-it-comes-to-gorillas-google-photos-remains-blind/

Portje, J. (2018) Microsoft’s neo-Nazi sexbot was a great lesson for makers of AI assistants, MIT Technology Review. Available at: https://www.technologyreview.com/2018/03/27/144290/microsofts-neo-nazi-sexbot-was-a-great-lesson-for-makers-of-ai-assistants/

Pavlus, J. (2020) Common Sense Comes to Computers, Quanta Magazine. Available at: https://www.quantamagazine.org/common-sense-comes-to-computers-20200430/

Knight, W. (2018) The US military wants to teach AI some basic common sense, MIT Technology Review. Available at: https://www.technologyreview.com/2018/10/11/103957/the-us-military-wants-to-teach-ai-some-basic-common-sense/

McCarthy, J. (1958) Programs with Common Sense, Pdfs.semanticscholar.org. Available at: https://pdfs.semanticscholar.org/dbeb/9dae2d88841a86cc0e8a13f76c99d204dfdc.pdf

Knight, W. (2020) Watson's Creator Wants to Teach AI a New Trick: Common Sense, Wired. Available at: https://www.wired.com/story/watsons-creator-teach-ai-new-trick-common-sense/

Pavlus, J. (2020) Common Sense Comes to Computers, Quanta Magazine. Available at: https://www.quantamagazine.org/common-sense-comes-to-computers-20200430/

Marcus, G. (2020) robust.ai, robust.ai. Available at: https://www.robust.ai/

Polhemus, J. (2020) CS News: Ellie Pavlick's Work With Language Acquisition And Information Retrieval Wins A Record-Setting Grant, Cs.brown.edu. Available at: https://cs.brown.edu/news/2020/01/13/ellie-pavlicks-work-language-acquisition-and-information-retrieval-wins-record-setting-grant/

Hills, T. (2018) Does my algorithm have a mental-health problem? – Thomas T Hills | Aeon Ideas, Aeon. Available at: https://aeon.co/ideas/made-in-our-own-image-why-algorithms-have-mental-health-problems

Sussan, R. (2018) Demain, des psychologues pour robots ?, InternetActu.net. Available at: http://www.internetactu.net/2018/04/24/demain-des-psychologues-pour-robots/

Rahwan, I., Cebrian, M. and al. (2019) Machine behaviour. Available at: https://www.nature.com/articles/s41586-019-1138-y?fbclid=IwAR3IZ45tLFPiha5RY8Om-O8CActlWY-5ixDRWAdKBCnNlO30I-3bz_l1fN8